Определение проблемы ограниченных данных

Ограниченность данных – это не просто недоработка в вашем рабочем процессе, а настоящая проблематика, которая ставит под угрозу результативность моделей обучения нейронных сетей. В условиях, когда доступно лишь ограниченное количество данных, нейросеть сталкивается с трудностями, способными значительно снизить её способность к обобщению. Поэтому важно понимать величие этой проблемы и её воздействие на качество предупредительных моделей.

Значимость обучения на малых выборках

Обучение на малых выборках становится актуальным решением для проектов, где собирать данные крайне затруднительно. Эффективность работы таких моделей часто зависит от способности адаптироваться и извлекать информацию, что если удаётся осуществить, может привести к выдающимся результатам и финансовым преимуществам. Поэтому стоит сосредоточиться на разработке методов и подходов, направленных на улучшение процесса обучения в условиях ограниченности данных.

Причины ограниченности данных

Редкие явления

Существуют ситуации, когда данные, необходимые для обучения, значительно ограничены по своей природе, например, в случае обнаружения новых, редких заболеваний. В таких случаях получить достаточный объём данных просто невозможно, и подступы к обучению требуют выбора специальных методов, чтобы добиться высоких показателей качества.

Конфиденциальность и защита данных

Забота о конфиденциальности данных становится главной причиной, по которой компании часто сталкиваются с ограничениями. С требованиями защиты персональных данных и соблюдения норм, таких как GDPR, организации вынуждены ограничивать доступ к данным и, следовательно, уменьшать объёмы обучающей информации.

Высокая стоимость сбора данных

Сбор данных может быть ресурсоёмким процессом, требующим инвестиций как в людские, так и в материальные ресурсы. Именно это ограничивает доступ многих компаний к необходимым объёмам информации, а иногда значительно увеличивает срок выполнения проекта.

Традиционные подходы к обучению нейронных сетей

Необходимость больших объемов данных

В стандартной практике считается, что для успешного обучения нейронных сетей необходимы большие массивы данных. Модели, построенные на обширных наборах информации, показывают высокую стабильность и обобщаемость, но как быть, когда данных недостаточно?

Ограничения при работе с малыми выборками

Традиционные подходы часто не работают должным образом на малых выборках, что побуждает исследователей искать альтернативные методы. Поскольку модели могут начать переобучаться на малом объёме данных, они становятся недостаточно надежными для реальных сценариев.

Методы обучения на ограниченных данных

Аугментация данных

Используйте аугментацию данных для увеличения объёма присутствующих выборок. Этот метод предполагает создание новых образцов на основе уже существующих путём применения различных трансформаций: вращения, отражения, изменения яркости и т. д.

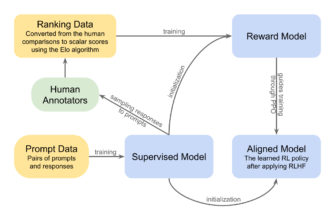

Трансферное обучение

Трансферное обучение позволяет использовать предобученные модели, которые уже вполне сформированы, и адаптировать их под свои задачи. Это значительно экономит время и затраты, так как вместо создания новой модели с нуля, можно перенести знания из одной задачи в другую.

Немногошотное обучение (Few-shot learning)

Воплотите в жизнь немногошотное обучение, которое предлагает методы, позволяющие учить модели на исключительно малом количестве примеров. Это достигается за счёт популярных техник, таких как мета-обучение и использование прототипных сетей для определения классов.

Обучение с нуля (Zero-shot learning)

Проведите исследование методов обучения с нуля, где модели обучаются идентифицировать объекты и классы, для которых у них не было примеров. Это можно осуществить, используя семантические характеристики объектов, такие как описание классов или их взаимосвязи.

Самоконтролируемое обучение (Self-supervised learning)

Погружайтесь в самоконтролируемое обучение, которое позволяет нейросетям обнаруживать и выучивать структуры данных без необходимости разметки. Здесь используются подходы контрастивного обучения и создания задач-прокси, что значительно упрощает процесс подготовки обучающих данных.

Активное обучение (Active learning)

Применяйте активное обучение для максимизации отдачи от малых выборок. Этот подход позволяет не просто использовать данные, а отбирать наиболее информативные примеры для обучения, что требует интерактивного участия эксперта в процессе.

Аугментация данных

Методы аугментации для различных типов данных

Подбирайте методы аугментации в зависимости от типа данных, с которыми работаете. Для изображений это могут быть изменения цвета, обрезка или повороты, а для текстов — замены синонимов или генерирование разнообразных текстовых вариаций.

Генеративные модели для создания синтетических данных

Исследуйте генеративные модели для создания синтетических данных, которые могут существенно увеличить малый объём существующих выборок. Использование таких инструментов, как GAN (Generative Adversarial Networks), позволяет получать новые, реалистичные примеры данных.

Ограничения и риски аугментации

Помните об ограничениях методики аугментации, так как неправильное применение может привести к созданию несуществующих паттернов, что негативно скажется на качестве модели. Следите за тем, чтобы добавленные данные соответствовали реальности и не добавляли шум.

Трансферное обучение

Принципы переноса знаний

Применяйте принципы переноса знаний, чтобы использовать уже компенсированные способности существующих моделей, адаптируя их под новые задачи. Этот процесс требует детального анализа сходств и различий между задачами.

Fine-tuning предобученных моделей

Финальная настройка (Fine-tuning) подразумевает дообучение предобученной модели на малом объёме данных, что помогает улучшить её результирующую производительность в новых условиях. Это может значительно ускорить процесс обучения.

Доменная адаптация

Не забывайте о доменной адаптации, где важно привести модель к более соответствующему контексту. Это позволяет трансформировать знания из одной области в практическое применение в другой, что является ключевым аспектом решения проблем с ограниченными данными.

Немногошотное обучение

Метрическое обучение

Встраивайте метрическое обучение в свои разработки, создавая системы, которые могут классифицировать объекты на основе метрик расстояния. Это эффективный подход, позволяющий работать с множеством классов даже при малом количестве данных.

Мета-обучение

Изучайте мета-обучение, где модель обучается на множестве различных задач, позволяя ей адаптироваться к новым задачам с минимальным количеством данных. Это становится базовым методом для создания высокоменяемых систем.

Прототипные сети

Выбирайте прототипные сети, которые помогают организовать обучение на основе схожести между изображениями, обрабатывая данные более структурированным образом. Такой подход позволяет значительно увеличить точность классификации на малых выборках.

Обучение с нуля

Использование семантической информации

Обратите внимание на использование семантической информации, когда речь идет о классах, для которых вы отсутствуют данные. Это позволяет более эффективно классифицировать новые виды, основываясь на их характеристиках.

Генерация признаков для неизвестных классов

Изучайте методы генерации признаков для неизвестных классов, что позволит нейросетям производить идентификацию без предварительного обучения. Это особенно важно в условиях ограниченности информации.

Самоконтролируемое обучение

Создание задач-прокси

Развивайте идеи создания задач-прокси для обучения, которые упростят процесс извлечения информации без необходимости разметки. Эти задачи могут варьироваться в сложности, обеспечивая необходимую гибкость для модели.

Контрастивное обучение

Внедряйте контрастивное обучение, которое позволяет выделять уникальные качества данных, обучая модель различать схожие и разные примеры, что существенно повышает её независимость.

Методы маскирования данных

Применяйте методы маскирования данных для улучшения обучения, где подаются только элементы, отсутствующие в выборке, что далее активизирует понимание модели о различных вариациях данных.

Активное обучение

Стратегии выбора наиболее информативных примеров

Разработайте стратегии для выбора наиболее информативных примеров, что существенно улучшит обучение, позволяя модели сначала столкнуться с важными экземплярами, прежде чем переходить к более стандартным.

Интерактивное обучение с участием эксперта

Подумайте об интерактивном обучении с участием эксперта, где профессионалы могут вручную предоставлять отзывы и коррекции, что напрямую влияет на быстрые результаты и даст модели возможность расти.

Регуляризация и предотвращение переобучения

L1 и L2 регуляризация

Используйте L1 и L2 регуляризацию как инструменты для борьбы с переобучением. Эти методы нацелены на уменьшение сложности модели и минимизацию риска ошибок при валидации.

Dropout

Применяйте технику Dropout, которая временно отключает определённые нейроны во время обучения. Это предотвращает зависимость между нейронами и улучшает общую устойчивость модели.

Ранняя остановка (Early stopping)

Имейте в виду раннюю остановку как стратегию, позволяющую остановить обучение на этапе, когда производительность модели начинает снижаться. Это предотвращает переобучение и улучшает конечное качество.

Архитектурные решения

Сиамские сети

Исследуйте сиамские сети, которые позволяют моделям Learn and Compare, что продвигает их способности к распознаванию схожих структур данных на основе их извлечённых признаков.

Сети с памятью

Изучите сети с памятью, которые помогают модели запоминать предыдущие обучающие примеры, что повышает её способности адаптироваться к новым примерам с учётом ранее полученного опыта.

Капсульные сети

Применяйте капсульные сети для улучшения способности нейросетей справляться с ротированными или поломанными изображениями. Это позволяет современным моделям лучше понимать сложные структуры.

Оценка и валидация моделей

Кросс-валидация на малых выборках

Внедрите кросс-валидацию как способ оценки модели на малых выборках, что позволяет оценить её производительность более объективно. Это создает возможность для более точной настройки моделей.

Метрики оценки для ограниченных данных

При оценке качества моделей используйте специфические метрики, такие как F1-score или ROC-AUC, которые более информативны в условии сильной классовой диспропорции и показывают настоящее состояние дел для малов выборостной модели.

Практические рекомендации

Выбор подхода в зависимости от задачи и доступных данных

Всегда выбирайте подходы на основе конкретной задачи и доступных данных. Определите, что именно вы пытаетесь достичь и как можно минимизировать риски получения нежелательных результатов.

Комбинирование методов

Смело комбинируйте различные методы и подходы, чтобы проложить дорогу к более стойким результатам. Экспериментируйте с комбинациями аугментации, трансферного обучения и активного обучения для создания прочной системы.

Примеры успешного применения

Проследите, как многие области, включая медицину и промышленность, добились успехов благодаря применению методов обучения нейронных сетей на ограниченных данных. К примеру, нейросети используются для диагностики заболеваний на основе небольших наборов медицинских изображений, что значительно ускоряет процесс.

Этические аспекты

Проблемы предвзятости при работе с ограниченными данными

Помните о возможных проблемах предвзятости, возникающих из-за малых выборок, которые могут исказить результаты работы модели. Это особенно актуально, когда речь идет о критически важных сферах, таких как здоровье или безопасность.

Обеспечение справедливости моделей

Сосредоточьтесь на обеспечении справедливости и отсутствии дискриминации в ваших моделях. Создавая искусственные системы, важно следить за тем, чтобы они не воспроизводили уже существующие предвзятости.

Будущие направления исследований

Развитие методов обучения на малых выборках

Следите за развитием и улучшением методов обучения на малых выборках, ведь каждая новая идея может привести к прорывным результатам. Изучение взаимодействий между нейросетями и традиционными подходами открывает новые горизонты.

Интеграция с другими областями ИИ

Изучайте перспективы интеграции с другими областями ИИ, такими как обработка естественного языка или компьютерный зрение. Комбинированные технологии способны решить задачи, которые на первый взгляд невозможно было бы решить с помощью одной нейросети.

Заключение

Исходя из всего вышеизложенного, обучение на ограниченных данных становится всё более актуальным. Объединяя различные методы и подходы, можно добиться впечатляющих результатов. Приглашайте к обсуждению, делитесь мыслями и опытом! Рассказывайте о нашем материале в социальных сетях, чтобы помочь другим погрузиться в эту важную тему!