Transfer learning: основные подходы и примеры использования

Определение transfer learning — это метод машинного обучения, который позволяет использовать знания, приобретенные на одной задаче, для улучшения процесса обучения на другой, схожей задаче. Этот подход особенно полезен, когда данные для целевой задачи ограничены или недостаточно качественны. Transfer learning дает возможность сократить время и ресурсы, необходимые для обучения моделей, сохраняя высокую точность и эффективность.

Значение transfer learning в современном машинном обучении невозможно переоценить. В эпоху, когда данные накапливаются с колоссальной скоростью, а задачи становятся все более сложными, возможность применять уже имеющиеся модели для решения новых проблем открывает новые горизонты. Все больше исследователей и разработчиков осознают преимущества transfer learning, который стал важным инструментом в арсенале современных нейросетей.

Основные принципы transfer learning

Перенос знаний между доменами — это основа transfer learning, где знания, полученные на одном наборе данных (источнике), используются для решения задачи на другом наборе данных (целевом). Такой процесс позволяет избежать необходимости изначально обучать модель с нуля, что требует значительных ресурсов.

Адаптация модели к новым задачам включает в себя дообучение модели на меньшем объеме данных, что позволяет улучшить результаты по сравнению с полностью новым обучением. Адаптация может происходить как на низком уровне (изменение весов), так и на высоком (изменение архитектуры). Это дает возможность быстро реагировать на новые вызовы.

Использование предобученных моделей — ещё один важный аспект transfer learning. Многие компании и исследовательские группы уже создали и обучили модели на своих данных, и использование таких моделей позволяет сэкономить время и ресурсы. Например, предобученные модели, такие как ResNet или BERT, доступны для использования и могут быть адаптированы под ваши задачи.

Типы transfer learning

Индуктивный перенос направлен на использование знаний из источника для решения новых задач с похожими данными. Он наиболее распространен и позволяет применить уже обученные модели на новых, похожих наборах данных.

Трансдуктивный перенос предполагает использование типа данных и распределения, чтобы перенести знания на конкретные примеры из нового домена, сохраняя особенности целевой задачи. Это повышает точность итогового результата, особенно в областях с ограниченными данными.

Неконтролируемый перенос не подразумевает наличие четкой метрики или меток. Это подход, при котором модель учится на данных без надлежащего аннотирования, например, в задачах кластеризации и создания представлений.

Подходы к transfer learning

Fine-tuning (тонкая настройка) представляет собой метод, при котором предобученная модель адаптируется на новой задаче, путем изменения весов некоторых слоев или обучения модели на дополнительно собранных данных. Это может обеспечить значительное улучшение результативности

Feature extraction (извлечение признаков) предполагает использование верхних слоев предобученной модели для генерации фич, которые затем используются в качестве входных данных для новой модели. Такой подход позволяет быстро внедрить уже существующие знания без окончательной адаптации всей модели.

Domain adaptation (адаптация домена) требует учета различий между доменами источника и назначения, чтобы свести к минимуму переобучение на специфичных для одного домена данных. Это может быть достигнуто с помощью специализированных методов или архитектур.

Multi-task learning (многозадачное обучение) включает в себя одновремённое обучение на нескольких задачах, что помогает улучшить производительность в каждой из них за счёт использования общих признаков. Это позволяет модели быть более универсальной.

One-shot learning (обучение по одному примеру) — это подход, который позволяет модели обучаться на одном примере новой задачи, что особенно полезно в ситуациях, когда данные крайне ограничены. Такой метод увеличивает эффективность работы с новыми классами объектов.

Архитектуры и модели для transfer learning

ResNet — это обширная архитектура с остаточными сетями, которая позволяет «перепрыгивать» слои, что делает ее эффективной для глубокого обучения. Использование ResNet в transfer learning позволяет добиться высокой точности при адаптации к новым задачам.

Трансформеры, такие как BERT и GPT, продемонстрировали революцию в области обработки естественного языка. Эти модели используют механизм внимания для акцентирования ключевых слов и фраз, что улучшает понимание текста.

VGG, Inception и EfficientNet — это другой набор мощных предобученных моделей для компьютерного зрения, которые показывают исключительные результаты в классификации изображений и других задачах. Их можно легко адаптировать для новых задач с использованием transfer learning.

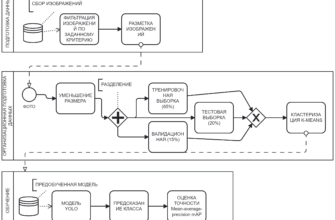

Процесс применения transfer learning

Выбор предобученной модели — первый шаг на пути к успешному применению transfer learning. Определите, какая модель лучше всего подойдет для вашей задачи с учетом требований и ограничения по ресурсам.

Анализ сходства между исходной и целевой задачами поможет выбрать подходящий метод переноса. Убедитесь, что данные схожи по структуре и содержанию для оптимизации результатов.

Определение стратегии переноса, например, «заморозка слоев» или «дообучение», является важным этапом. Эта стратегия должна соответствовать специфике вашей задачи и количеству доступных данных.

Адаптация архитектуры модели может включать добавление новых слоев или изменение существующих, чтобы модель лучше подходила для целевой задачи. Убедитесь, что изменения не ухудшают качество предсказаний.

Обучение и оптимизация — это завершающий шаг, где вы тестируете модель, вносите корректировки и улучшаете параметры для достижения максимальной точности.

Применение transfer learning в различных областях

Компьютерное зрение — это одна из главных областей, где находит применение transfer learning. С его помощью вы можете осуществлять классификацию изображений, обнаружение объектов и сегментацию изображений с минимальными затратами и временем.

Обработка естественного языка (NLP) использует transfer learning для таких задач, как анализ тональности, классификация текстов и машинный перевод. Это позволяет ускорить обучение моделей, способных понимать и генерировать текст.

Распознавание речи также активно использует transfer learning для повышения точности распознавания голосовых команд и фраз, особенно в контексте многопользовательских сред.

Биоинформатика использует transfer learning для анализа геномов, что позволяет переводить знания из одной области в другую, минимизируя свои затраты на сбор данных.

Преимущества использования transfer learning

Сокращение времени обучения — одно из самых очевидных преимуществ. Использование предобученных моделей значительно ускоряет процесс, поскольку нет необходимости обучать модель с нуля.

Улучшение производительности при ограниченных данных позволяет достичь высоких показателей точности, когда доступные данные для обучения ограничены или имеют низкое качество.

Возможность решения сложных задач с меньшими ресурсами открывает пути для внедрения инновационных решений в сферах, где бюджет и время критичны.

Проблемы и ограничения transfer learning

Отрицательный перенос — это проблема, при которой перенос знаний из одной задачи в другую приводит к ухудшению результатов. Это может произойти, если домены слишком различны.

Выбор подходящей предобученной модели может быть сложной задачей, так как модели проявляют свои сильные стороны в разных задачах. Нужно тщательно оценивать их соответствие вашему проекту.

Адаптация к сильно отличающимся доменам требует значительных усилий, и простой перенос может не оказать ожидаемого эффекта. В таких случаях могут понадобиться сложные методы адаптации.

Оценка эффективности transfer learning

Метрики оценки, такие как точность, полнота и F1-метрика, помогут вам понять, насколько хорошо модель справляется с задачами после переноса. Используйте данные для оптимизации и корректировки модели.

Сравнение с обучением с нуля дает вам возможность выяснить, насколько transfer learning эффективнее. В большинстве случаев результаты переноса будут значительно выше.

Анализ влияния различных стратегий переноса поможет выбрать наиболее продуктивный способ. Попробуйте разные подходы, чтобы понять, какой из них наиболее работает для вашей задачи.

Инструменты и библиотеки для transfer learning

TensorFlow и Keras — это популярные библиотеки, предлагающие множество инструментов для работы с transfer learning. Они позволяют быстро создавать и адаптировать модели для различных задач.

PyTorch также стал основным инструментом для разработки моделей с использованием transfer learning, благодаря своей гибкости и простоте.

Hugging Face Transformers — это библиотека, специализирующаяся на трансформерах, которая предоставляет обширные возможности для работы с NLP задачами и transfer learning.

Примеры успешного применения transfer learning

Кейсы из индустрии показывают, как крупные компании применяют transfer learning для улучшения своих сервисов. Например, использование предобученных моделей в области здравоохранения позволило значительно повысить точность диагностики.

Научные исследования также демонстрируют успехи в передовых областях, от биоинформатики до автоматизации. Эти примеры вдохновляют и служат ориентиром для тех, кто только начинает свой путь в machine learning.

Будущие направления развития transfer learning

Улучшение обобщающей способности моделей подразумевает разработку новых подходов к transfer learning, направленных на лучшее качество вывода при ограниченных данных.

Автоматический выбор оптимальной стратегии переноса — важная задача в будущем, которая поможет упростить процесс применения transfer learning для невиданных задач.

Интеграция с другими методами машинного обучения может помочь создать более мощные модели, комбинируя достоинства различных подходов и методов.

Заключение

Transfer learning представляет собой мощный инструмент в арсенале искусственного интеллекта и машинного обучения. Его применение позволяет существенно повысить эффективность и производительность моделей, минимизируя затраты на обучение и улучшая результаты. Будущее transfer learning предполагает дальнейшие исследования, новые подходы и интеграции, которые откроют новые горизонты в мире технологий.

Оставьте свое мнение о transfer learning в комментариях и не забывайте делиться этой статьёй в социальных сетях! Да начнётся процесс обмена знаниями!

Для более глубокого погружения в эту тему, ознакомьтесь с дополнительными материалами: статья на Хабре, использование Transfer Learning в DLOM и многие другие ресурсы.